Evolução da PLN: IA Fragmentada para Modelos Fundamentais

Definições

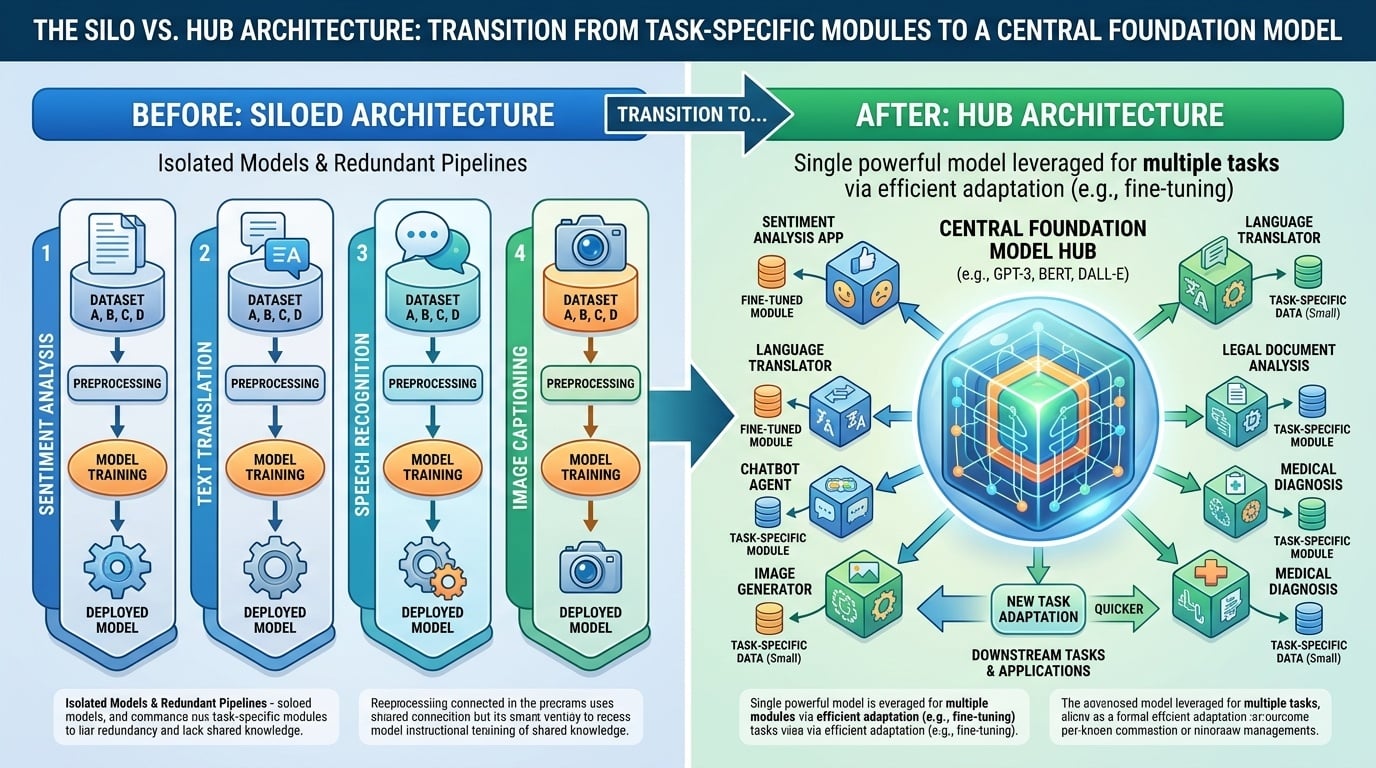

- IA Fragmentada: Uma era definida por arquiteturas neurais discretas e especializadas projetadas para tarefas individuais, como rotulagem de sequências ou classificação.

- Modelo Fundamental: Uma arquitetura monolítica de transformador unificada que trata todos os problemas linguísticos como uma sequência gerativa texto-para-texto $x \rightarrow y$.

Conceitos Principais

- Consolidação Arquitetônica: Historicamente, a PLN exigia pipelines personalizados (Bi-LSTMs para NER, CNNs para sentimento). Os LLMs colapsam esses silos em um único núcleo onde os mesmos pesos são utilizados para todas as tarefas.

- A Interface Unificada: Os LLMs substituem as "cabeças de saída" especializadas (por exemplo, Softmax de 3 classes) por uma interface de linguagem natural. Entradas e saídas são sempre strings, permitindo que o modelo interprete intenção em vez de formato.

- Transferência de Conhecimento: Modelos tradicionais eram "uma lousa em branco" para cada tarefa. Os LLMs priorizam Generalização em Primeiro Lugar, onde tarefas específicas são meras aplicações de uma representação interna robusta e pré-existente da linguagem.

Contexto Histórico

- Antes de 2018: A isolação de tarefas exigia treinar modelos distintos com funções de perda diferentes $\mathcal{L}_{task}$.

- Era Moderna: O paradigma "Texto-para-Texto" permite que um único modelo (por exemplo, Llama-3) mude de tarefas por meio de solicitações zero-shot ou few-shot.

Comparação da Implementação em Python